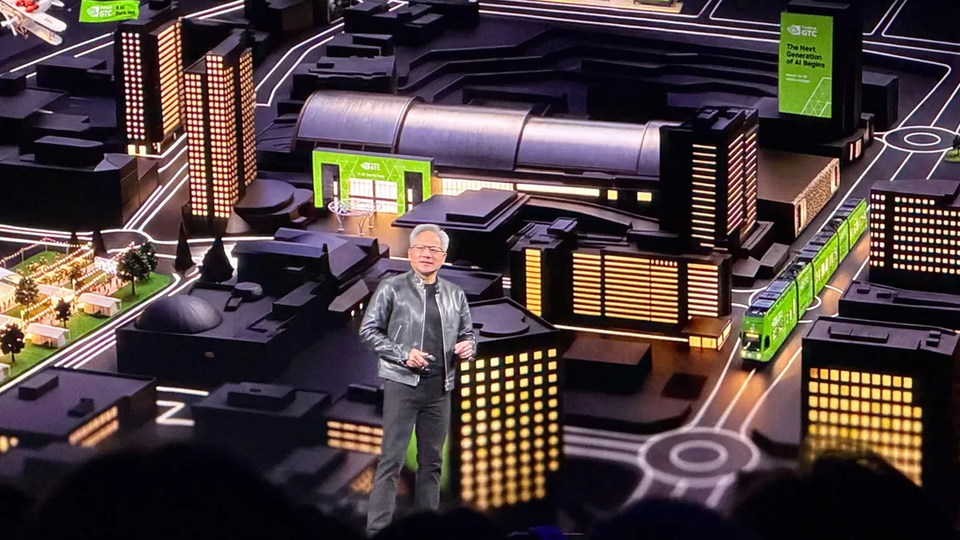

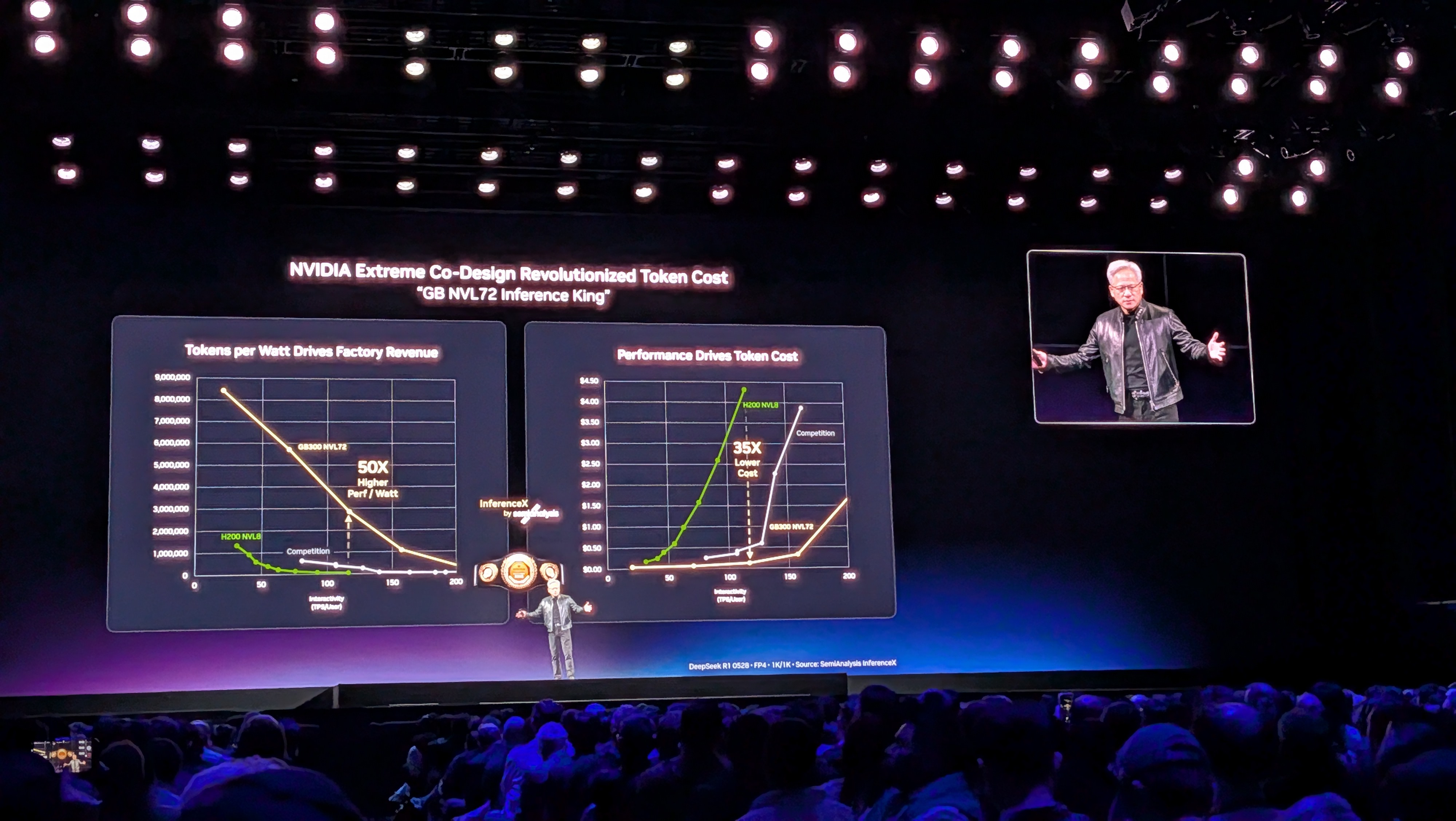

Trong bài phát biểu tại NVIDIA GTC 2026 diễn ra vào ngày 16-17/03/2026 vừa qua tại San Jose, California, Jensen Huang - CEO NVIDIA đưa ra một luận điểm rất đáng suy ngẫm: “Nếu AI là một nhà máy trí tuệ, thì đầu ra của nó không phải là phần mềm, mà là Token.” Cách nhìn này tưởng chừng đơn giản, nhưng thực chất lại mở ra một hệ quy chiếu hoàn toàn mới về cách chúng Hiểu đơn giản, mỗi lần AI xử lý một yêu cầu - trả lời, viết nội dung hay thực hiện tác vụ - đều tiêu thụ Token. Vì vậy, Token không chỉ là khái niệm kỹ thuật, mà là đơn vị đo chi phí, năng suất và giá trị của AI.

Doanh nghiệp ứng dụng AI không còn tối ưu AI, mà tối ưu Token

Điều này có ý nghĩa gì với doanh nghiệp?

Thay vì đo lường tăng trưởng bằng user hay traffic, doanh nghiệp bước vào một hệ quy chiếu mới: khả năng sử dụng và tối ưu Token. Ai tối ưu tốt hơn sẽ: giảm chi phí vận hành AI, tăng tốc độ phản hồi, mở rộng quy mô hiệu quả hơn

Ba điều doanh nghiệp cần hiểu về “Token Economy”

1. Token là chi phí thực, không phải chi phí ẩn

Mỗi lần gọi AI đều tiêu tiền. Nếu không đo lường và kiểm soát, chi phí sẽ tăng rất nhanh khi scale.

2. Hiệu quả AI bằng hiệu quả sử dụng Token

Không phải model mạnh nhất là tốt nhất. Model phù hợp + thiết kế đúng mới là thứ tạo ra hiệu quả.

3. Cạnh tranh sẽ nằm ở tối ưu, không phải ở quy mô

Đặc biệt với các thị trường như Việt Nam, lợi thế không nằm ở tài nguyên tiêu thụ, mà ở khả năng dùng ít Token hơn để tạo ra nhiều giá trị hơn.

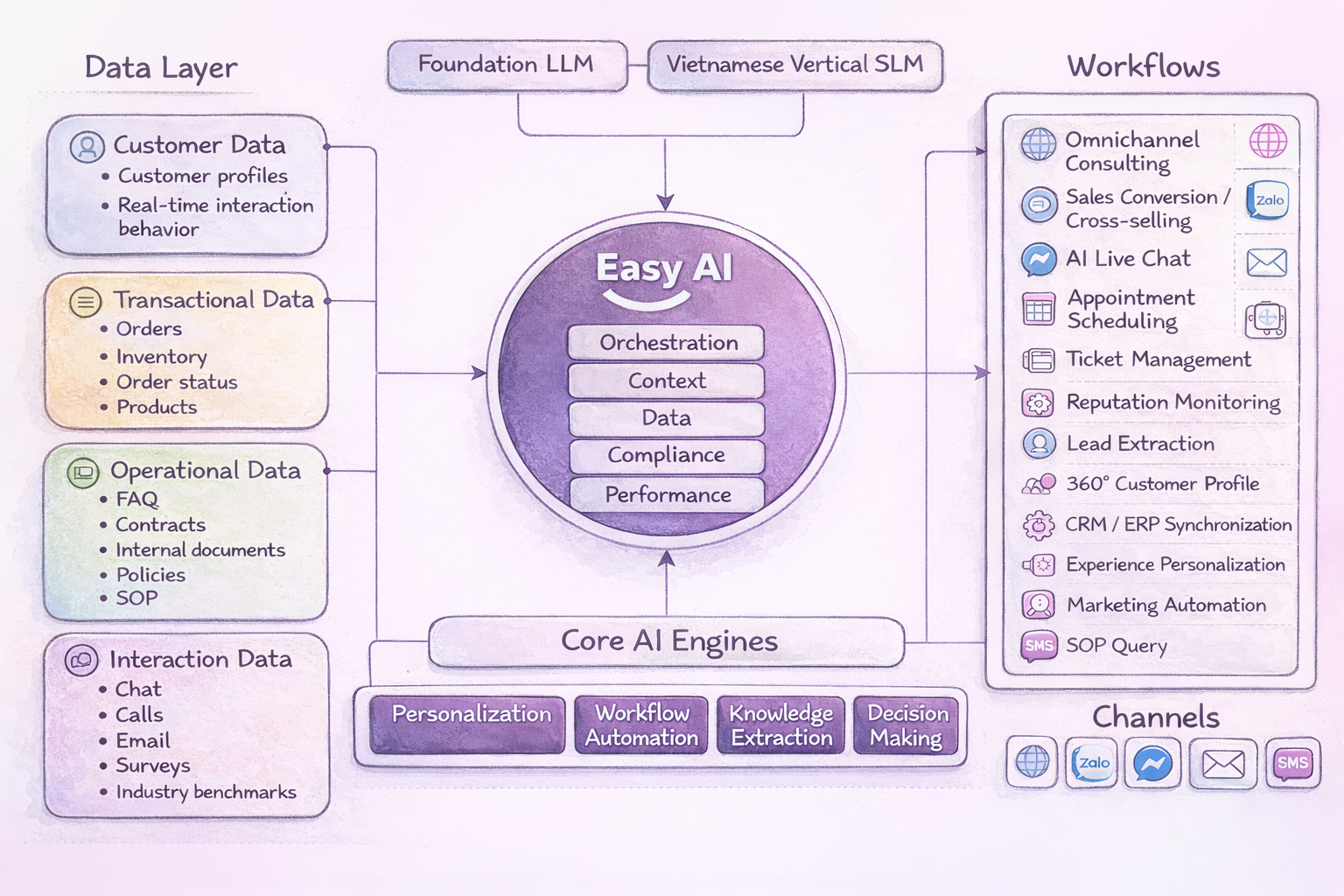

Đó cũng là lý do các hướng tiếp cận như AI-native hay Small Language Model (SLM) ngày càng quan trọng: phân rã bài toán, chọn đúng model, và tối ưu toàn bộ luồng xử lý.

Các kiến trúc AI-native và hướng tiếp cận với SLM ngày càng trở nên quan trọng. Thay vì phụ thuộc hoàn toàn vào một mô hình ngôn ngữ lớn (LLM) với chi phí cao, xu hướng mới là phân rã bài toán, lựa chọn mô hình phù hợp cho từng tác vụ và điều phối toàn bộ luồng xử lý. Mục tiêu không phải là sử dụng AI nhiều hơn, mà là đạt được cùng một kết quả với lượng Token ít hơn. Đây là một sự chuyển dịch từ tư duy “mở rộng bằng tài nguyên” sang “mở rộng bằng tối ưu”.

Tại Easy AI, chúng tôi tiếp cận AI không phải như một công cụ riêng lẻ, mà như hệ thống sản xuất cần được thiết kế và vận hành có chủ đích. Trọng tâm không nằm ở việc tăng mức độ sử dụng AI, mà ở việc đảm bảo mỗi token được sử dụng đúng chỗ, đúng cách và tạo ra giá trị cao nhất. Điều này đòi hỏi sự kết hợp giữa hiểu ngữ cảnh, điều phối nhiều mô hình và tối ưu toàn bộ pipeline xử lý - bài toán mang tính hệ thống hơn là đơn lẻ.

Chúng tôi nhìn AI như một hệ thống cần được tối ưu đầu cuối, với mục tiêu không phải là “dùng nhiều AI hơn”, mà là tối đa hóa giá trị trên từng Token.

Quá trình triển khai thực tế, Easy AI đã trực tiếp vận hành hơn 30 tỷ Token trong các hệ thống AI cho doanh nghiệp xem chi tiết. Từ chính trải nghiệm thực chiến này, chúng ta hiểu rõ cần xây dựng các thuật toán nòng cốt về hiểu ngữ cảnh và điều phối nhiều model AI, nhằm đảm bảo mỗi tác vụ được xử lý với lượng Token tối ưu nhất. Tiếp đó, chúng tôi phát triển các SLM cho từng bài toán cụ thể như CSAT, giúp doanh nghiệp giảm đáng kể chi phí Token nhưng vẫn giữ vững, thậm chí cải thiện trải nghiệm khách hàng.

Và chúng tôi chắc chắn rằng, bài toán của doanh nghiệp không phải là dùng AI nhiều hơn, mà là dùng thông minh hơn.